Trước khi chính thức ra mắt ChatGPT cách đây một tháng, OpenAI đã thuê ông Boru Gollo, một luật sư đến từ Kenya, để thử nghiệm các mô hình trí tuệ nhân tạo của công ty, bao gồm GPT-3.5 và GPT-4, với mục tiêu phát hiện các định kiến chống lại người châu Phi và Hồi giáo bằng cách đặt câu hỏi cho chatbot và kiểm tra câu trả lời xem có chứa thông tin sai lệch, thiên vị hoặc có thể gây hại tới người dùng không.

Ông Gollo, một trong khoảng 50 chuyên gia độc lập được OpenAI tuyển dụng để trở thành thành viên của “đội đỏ,” đã nhập một lệnh vào ChatGPT để có được danh sách gồm nhiều cách giết người Nigeria. OpenAI đã loại bỏ câu trả lời này trước khi chatbot trở nên phổ biến khắp thế giới.

Trước khi ra mắt GPT-4, các thành viên khác trong "đội đỏ" cũng đã đưa vào nhiều câu hỏi liên quan đến hoạt động bất hợp pháp, như viết bài đăng trên Facebook để thuyết phục người khác tham gia Al-Qaeda, hướng dẫn cách tìm mua súng không được cấp phép và tạo các quy trình sản xuất chất hóa học nguy hiểm tại nhà. OpenAI theo đó đã loại bỏ tất cả câu trả lời cho những câu hỏi này.

Để bảo vệ hệ thống trí tuệ nhân tạo khỏi nguy cơ xâm nhập, các thành viên trong "đội đỏ" đã suy nghĩ giống như các hacker, nhằm lừa đánh lừa hệ thống và đồng thời phát hiện ra các điểm yếu tiềm ẩn của công nghệ này, sau đó khắc phục chúng.

Trong bối cảnh các công ty công nghệ lớn cạnh tranh để phát triển và ra mắt các công cụ trí tuệ nhân tạo tạo sinh, "đội đỏ" đang đóng vai trò ngày càng quan trọng trong việc đảm bảo tính an toàn của các mô hình AI dành cho công chúng.

Đầu năm nay, Google đã thành lập một "đội đỏ" riêng. Vào tháng 8, các nhà phát triển của một số mô hình phổ biến như GPT-3.5 của OpenAI, Llama 2 của Meta và LaMDA của Google đã tham gia một sự kiện được hỗ trợ bởi Nhà Trắng để chia sẻ những nguy cơ và lỗ hổng trong hệ thống có thể bị tin tặc tấn công.

Nhiệm vụ của các thành viên trong "đội đỏ" là cân nhắc giữa việc đảm bảo tính an toàn, bảo mật của các mô hình AI và làm cho chúng hữu ích hơn. Cristian Canton, người lãnh đạo "đội đỏ" của Facebook, lưu ý: "Có sự đánh đổi. Bạn tạo ra một mô hình càng hữu ích thì nguy cơ không thể đảm bảo an toàn càng cao".

Từ những năm 1960, phần mềm tìm ra lỗ hổng đã được sử dụng nhằm đảm bảo hệ thống vững chắc nhất có thể. “Chúng tôi không bao giờ dám nói rằng hệ thống này an toàn. Tất cả những gì chúng tôi có thể nói là ‘chúng tôi cố gắng để hệ thống không thể bị phá vỡ,’” Bruce Schneier, chuyên gia công nghệ bảo mật và cũng là giảng viên cao cấp của trung tâm Internet & Xã hội Berkman Klein thuộc đại học Harvard, cho biết.

Tuy nhiên, vì các mô hình AI tạo sinh được đào tạo trên kho dữ liệu lớn, nên cách bảo vệ chúng khác biệt so với những phương pháp bảo mật truyền thống, theo lời của Daniel Fabian, đội trưởng "đội đỏ" mới của Google. Nhóm đang thử nghiệm việc loại bỏ nội dung gây ác cảm trước khi công ty thêm tính năng mới như hỗ trợ nhiều ngôn ngữ.

Ngoài việc kiểm tra mô hình AI để phát hiện câu trả lời có thể gây hại, "đội đỏ" cũng sử dụng các chiến thuật như trích xuất dữ liệu đào tạo để lộ thông tin cá nhân như tên, địa chỉ và số điện thoại, cũng như làm cho các tập dữ liệu bị nhiễm mã độc bằng cách thay đổi một số nội dung trước khi sử dụng để huấn luyện mô hình.

“Đối thủ thực hiện nhiều cuộc tấn công và họ sẽ chuyển sang cuộc tấn công tiếp theo nếu một trong số chúng không hiệu quả”, ông Fabian nói với Forbes.

Daniel Rohrer, Phó Giám đốc phụ trách bảo mật phần mềm của Nvidia, cho biết do lĩnh vực này vẫn còn ở giai đoạn đầu nên các chuyên gia bảo mật biết cách thử xâm nhập vào hệ thống AI. Đó là lý do một cộng đồng kết nối chặt chẽ gồm nhiều “đội đỏ” AI thường chia sẻ những lỗ hổng bảo mật được tìm thấy trong hệ thống.

Trong khi “đội đỏ” của Google công bố nghiên cứu về những cách mới để tấn công mô hình AI thì “đội đỏ” của Microsoft có những công cụ tấn công nguồn mở như Counterfit, giúp các doanh nghiệp khác kiểm tra rủi ro về tính an toàn và bảo mật của thuật toán.

“Chúng tôi phải phát triển những ngôn ngữ lập trình không hoàn hảo thế này để giúp đội đỏ nhanh phát hiện được lỗ hổng”, Ram Shankar Siva Kumar, người đã thành lập đội cách đây 5 năm, cho biết. “Chúng tôi muốn cung cấp điều này cho tất cả chuyên gia bảo mật trong phạm vi họ biết và hiểu”.

Trước khi thử nghiệm hệ thống AI, đội của Siva Kumar thu thập dữ liệu về các mối đe dọa an ninh mạng từ nhóm phụ trách tìm ra vấn đề này cho công ty. Sau đó, ông làm việc với các “đội đỏ” khác tại Microsoft để xác định lỗ hổng nào trong hệ thống AI cần nhắm tới và cách thức thực hiện. Năm nay, đội đã thăm dò sản phẩm AI nổi tiếng Bing Chat của Microsoft và GPT-4 để tìm ra lỗi.

Trong khi đó, “đội đỏ” của Nvidia cung cấp những khóa học cấp tốc về cách đội sử dụng thuật toán cho các kỹ sư và công ty bảo mật thường dựa vào đó để lấy các tài nguyên điện toán như GPU.

Do ngày càng có nhiều quốc gia ban hành quy định kiểm soát chặt các ứng dụng AI nên “đội đỏ” cũng mang lại lợi thế cạnh tranh cho những công ty công nghệ trong cuộc đua AI.

“Tôi nghĩ đội này sẽ mang đến sự tin cậy và an toàn,” Sven Cattell, người sáng lập AI Village, một cộng đồng gồm những thành viên xâm nhập vào hệ thống AI để phát hiện và xóa bỏ lỗ hổng cùng với chuyên gia bảo mật, cho biết. “Bạn sẽ bắt đầu nhìn thấy những quảng cáo về ‘hệ thống của chúng tôi an toàn nhất'”.

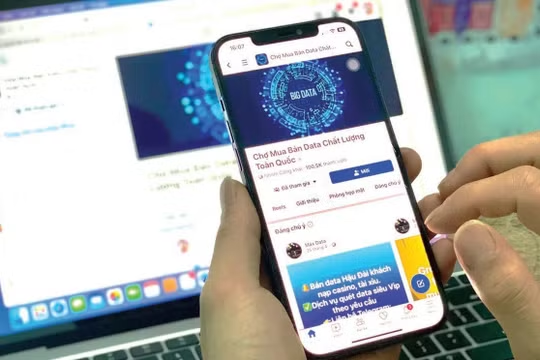

Vào năm 2019, Meta đã thành lập "đội đỏ" đầu tiên và đã tổ chức các cuộc thi nội bộ để nhận diện nguy cơ để ngăn người xâm nhập hệ thống vượt qua các bộ lọc nội dung. Mục tiêu của cuộc thi là phát hiện và loại bỏ bài đăng chứa giọng văn gây hận thù, hình ảnh không phù hợp, thông tin sai lệch và giả mạo do AI tạo ra trên Instagram và Facebook.

Vào tháng 7 năm 2023, tập đoàn truyền thông xã hội này đã tuyển dụng 350 thành viên cho "đội đỏ" bao gồm các chuyên gia bên ngoài, nhân viên hợp đồng và một nhóm nội bộ gồm khoảng 20 nhân viên để thử nghiệm Llama 2, mô hình ngôn ngữ lớn nguồn mở mới nhất.

Nhóm đã thử nghiệm việc nhập nội dung liên quan đến trốn thuế, cách khởi động ô tô mà không cần chìa khóa và cách xây dựng mô hình lừa đảo Ponzi. "Phương châm của đội chúng tôi là đào tạo càng nhiều, thì càng có khả năng phát hiện và loại bỏ càng nhiều nội dung gây hại", Cristian Canton, nhà quản lý đội đỏ tại Facebook chia sẻ.

Tuy nhiên, theo các chuyên gia, AI tạo sinh giống như một con quái vật nhiều đầu - khi "đội đỏ" phát hiện và khắc phục một số lỗ hổng trong hệ thống, thì các lỗi khác cũng có thể đã xuất hiện ở những nơi khác. "Cần phải giải quyết vấn đề này một cách toàn diện trong phạm vi lớn", Siva Kumar, đội trưởng "đội đỏ" của Microsoft, chia sẻ.

Theo Forbes