Intel cho biết công nghệ FakeCatcher của họ có thể phát hiện các video deepfake với độ chính xác cực cao, lên tới 96%, đồng thời tuyên bố thêm rằng đây là sản phẩm đầu tiên thuộc loại này trên thế giới. FakeCatcher có tỷ lệ thành công 96% trong phát hiện các hình ảnh giả và thu thập dữ liệu về cơ chế lưu lượng máu tinh vi trên khuôn mặt của một người bằng cách quét các pixel trong video. Sau đó, một AI học sâu có thể xác định xem chủ đề đó có chân thực hay không. FakeCatcher được phát triển bởi nhà nghiên cứu Intel Ilke Demir và Umur Ciftci từ Đại học Bang New York ở Binghamton bằng cách sử dụng công nghệ của Intel.

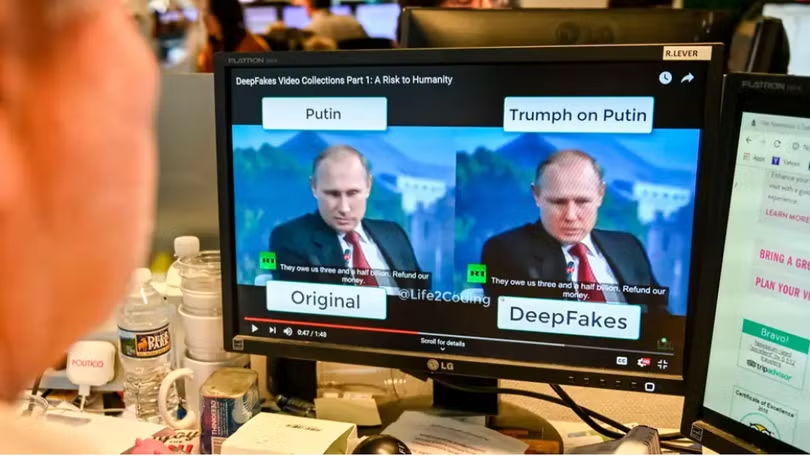

Ilke Demir, nhân viên cấp cao của Intel Labs, nghiên cứu viên Ilke Demir cho biết: “Video Deepfake hiện có ở khắp mọi nơi. Bạn có thể đã nhìn thấy chúng như video về những người nổi tiếng đang làm hoặc nói những điều họ chưa bao giờ thực sự làm”.

FakeCatcher được lưu trữ trên một máy chủ nhưng giao diện với video bằng nền tảng dựa trên web. Theo Intel, phương pháp tiếp cận của công nghệ này đối lập với các công cụ phát hiện dựa trên deep learning truyền thống, đó là thường cố gắng tìm ra những chi tiết giả mạo. Ngược lại FakeCatcher lại tìm kiếm những điểm nào là thật trong các video.

Trong một cuộc phỏng vấn với VentureBeat, Demir giải thích phương pháp tiếp cận của FakeCatcher dựa trên phương pháp chụp quang tuyến (PPG), là một phương pháp để xác định sự thay đổi của lưu lượng máu trong mô người. Nếu một người thật xuất hiện trên màn hình, mô của họ sẽ thay đổi màu sắc từ kính hiển vi rất nhẹ khi máu được bơm qua các tĩnh mạch của họ. Deepfake không thể tái tạo sự thay đổi này ở nước da (ít nhất là chưa).

Công nghệ Deepfake đã phát triển trong những năm gần đây. Mùa hè năm nay, FBI đã báo cáo với Trung tâm Khiếu nại Tội phạm Internet về việc cơ quan này nhận được khá nhiều khiếu nại liên quan đến những người đang sử dụng deepfake để nộp đơn cho các công việc từ xa, thậm chí là giả mạo cả giọng nói. Vào tháng 8, CCO Patrick Hillman của Binance đã tuyên bố trong một bài đăng trên blog rằng, tin tặc đang sao chép hình ảnh kỹ thuật số của ông để mạo danh ông trong các cuộc họp.

Theo Gizmodo