Mô phỏng cấu trúc não người cho việc thiết kế phần mềm và chất bán dẫn là mục tiêu lâu dài trong lĩnh vực nghiên cứu trí tuệ nhân tạo (AI).

Mặc dù các loại chip có cấu trúc mô phỏng hệ thần kinh người (neuromorphic) có những bước tiến đáng kể, có thể chạy nhiều phép tính đồng thời và vừa tính toán vừa lưu trữ dữ liệu, nhưng vẫn chưa thể mô phỏng được cơ chế siêu tiết kiệm năng lượng của hoạt động não người.

Tính toán bằng AI yêu cầu nhiều năng lượng, nhưng hầu hết năng lượng tiêu thụ không phải trong quá trình tính toán. Phần tiêu tốn nhiều năng lượng nhiều nhất là quá trình di chuyển dữ liệu giữa bộ nhớ và các đơn vị tính toán nằm trong chip AI.

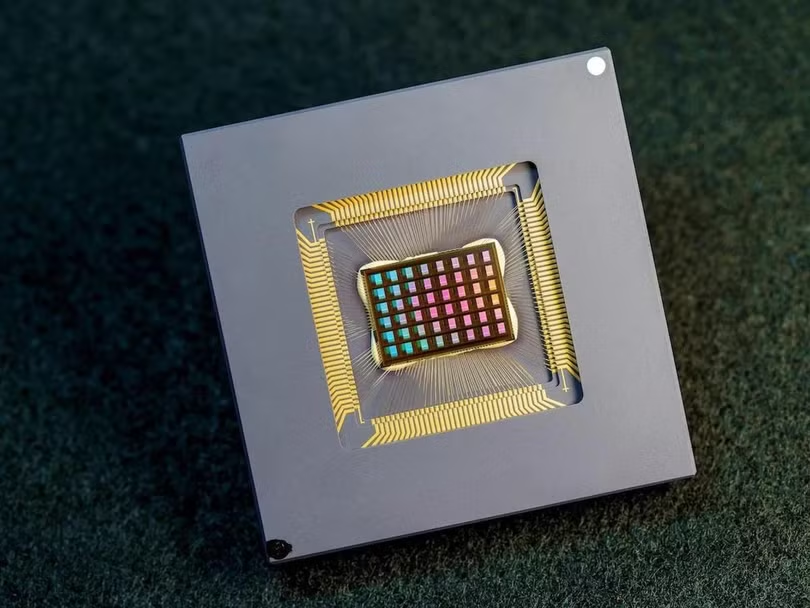

Để giải quyết vấn đề này, một nhóm nhà khoa học IT Mỹ phát triển một nguyên mẫu của chip tính toán-trong-bộ nhớ ('compute-in-memory chip', viết tắt là CIM) mới, giúp loại bỏ sự cần thiết của sự tách biệt này.

Trong báo cáo khoa học, đăng tải trên tạp chí Nature ngày 17/8, các nhà khoa học tuyên bố, nguyên mẫu CIM cho thấy hiệu quả gấp đôi so với các nền tảng AI hiện có. Được gọi là NeuRRAM do sử dụng một loại RAM, được gọi là bộ nhớ truy cập ngẫu nhiên điện trở (RRAM), phần cứng RRAM-CIM 48 lõi này hỗ trợ một loạt các mô hình và kiến trúc mạng thần kinh.

Nhà nghiên cứu Weier Wan thuộc Đại học Stanford , tác giả thứ nhất của bài báo cho biết, RRAM có nhiều lợi ích so với bộ nhớ thông thường. Một trong những ưu thế là dung lượng nhớ cao hơn trong cùng một diện tích chất bán dẫn (silicon), cho phép triển khai các mô hình AI lớn hơn. RRAM cũng không bay hơi (có thể lưu trữ thông tin khi mất điện), có nghĩa là không có rò rỉ điện.

Lợi thế này khiến các chip dựa trên RRAM rất lý tưởng cho những nhiệm vụ điện toán biên (edge computing), đối lập với điện toán đám mây (cloud computing). Các nhà nghiên cứu dự kiến chip NeuRRAM xử lý hiệu quả hàng loạt các ứng dụng AI phức tạp trên những thiết bị công suất thấp, không cần dựa vào kết nối mạng với đám mây.

Để thiết kế NeuRRAM, nhóm nghiên cứu đã cân nhắc kỹ lưỡng giữa tính hiệu quả, tính linh hoạt và độ chính xác, mà không phải loại trừ bất kỳ yếu tố nào. Ông Wan nói: “Sự đổi mới chính là chúng tôi sử dụng một sơ đồ mới chuyển đổi tín hiệu analog sang tín hiệu kỹ thuật số, vì đây được coi là điểm nghẽn chính đối với hiệu quả năng lượng trong chip CIM. Nhóm đã phát minh ra một sơ đồ mới trên cơ sở cảm nhận điện áp, những sơ đồ trước đó dựa trên cảm nhận cường độ dòng điện.” Cảm biến theo chế độ điện áp cũng cho phép tính song song hiệu suất cao hơn của mảng RRAM trong một chu kỳ tính toán duy nhất.

Nhóm nghiên cứu khám phá một số kiến trúc mới, chẳng hạn như mảng tiếp hợp thần kinh có thể chuyển đổi (TNSA), kiểm soát linh hoạt các hướng luồng dữ liệu.

Ông Wan giải thích: “Để có độ chính xác, điều kiện then chốt là thuật toán và thiết kế phần cứng. Cấu trúc của RRAM cho phép mô hình hóa các đặc điểm phần cứng trực tiếp trong các mô hình AI này, cho phép thuật toán thích ứng với những điều không lý tưởng của phần cứng và duy trì độ chính xác”. Nói cách khác, nhóm nghiên cứu đã tối ưu hóa toàn bộ ngăn xếp — từ thiết bị đến mạch, kiến trúc đến thuật toán để tạo ra một con chip đồng thời hiệu quả, linh hoạt và có độ chính xác cao.

Gert Cauwenberghs , nhà nghiên cứu IT tại Đại học California, San Diego, một trong những tác giả của bài báo cho biết, “Hầu hết những kết quả đạt được trong bộ nhớ máy tính đều bị giới hạn ở các bản demo cấp độ phần mềm, sử dụng hàng loạt các khớp thần kinh. Nhưng ở đây chúng tôi đặt tất cả lại cấp độ mặt phẳng ngang trên ngăn xếp”.

NeuRRAM đạt độ chính xác 99% đối với tác vụ nhận dạng chữ số viết tay, 85.7% đối với tác vụ phân loại hình ảnh, 84.7% đối với tác vụ nhận dạng lệnh bằng giọng nói của Google và giảm 70% lỗi tái tạo hình ảnh đối với tác vụ khôi phục ảnh. Các nhà khoa học kết luận: “Những kết quả này có thể so sánh với những chip kỹ thuật số hiện có, thực hiện tính toán với cùng độ chính xác bit, nhưng tiết kiệm đáng kể năng lượng”.

So sánh NeuRRAM với chip thần kinh Loihi 2 của Intel, khối xây dựng của hệ thống Pohoiki Beach 8 triệu nơ-ron thần kinh, nhóm nghiên cứu tuyên bố, chip NeuRRAM có hiệu quả cao hơn. Loihi là bộ xử lý kỹ thuật số tiêu chuẩn với các ngân hàng SRAM, một ISA (kiến trúc tập lệnh) cụ thể có thể lập trình. Siddharth Joshi, nhà nghiên cứu tại Đại học Notre Dame, đồng tác giả bài báo cho biết thêm: “Chip thần kinh Loihi - 2 sử dụng kiến trúc von Neumann nhiều hơn, trong khi tính toán của chúng tôi thực hiện trên chính dòng bit”.

Những nghiên cứu cho thấy, các chip thần kinh đa hình, bao gồm cả Loihi, có thể có nhiều ứng dụng hơn không chỉ AI như phân tích y tế và kinh tế, trong các nhu cầu điện toán lượng tử.

Các nhà phát triển NeuRRAM khẳng định rằng, thiết kế những kiến trúc tính toán-trong-bộ nhớ chính là tương lai của ngành chip AI. Cauwenberghs cho biết thêm, NeuRRAM mở ra một khả năng vượt trội về mặt kiến trúc do có dãy các lõi song song, mỗi lõi thực hiện tính toán độc lập, kiến trúc này cho phép triển khai các mạng lớn với kết nối tùy ý, tiêu hao năng lượng ở mức tối thiểu.

Nhóm nghiên cứu cho rằng, còn rất sớm để thương mại hóa NeuRRAM chip. Nhưng việc triển khai phần cứng hiệu quả của chip với bộ nhớ máy tính là một sự kết hợp thành công.

Ông Cauwenberghs nói: “Chúng tôi đang tiếp tục làm việc để tích hợp những quy tắc học tập.” Các phiên bản AI trong tương lai sẽ có thể học với một con chip trong vòng lặp, những tiến bộ trong công nghệ RRAM cho phép AI học gia tăng trên quy mô lớn.”

Ông Wan cũng cho biết thêm, để thương mại hóa chíp trở thành hiện thực, công nghệ RRAM phải trở nên thông dụng và dễ dàng cho các nhà thiết kế chip.

Theo Spectrum