Người dùng luôn lo ngại những gã khổng lồ công nghệ hoặc bên thứ ba có thể lạm dụng các mô hình ngôn ngữ lớn (LLM) để thu thập nhiều dữ liệu riêng tư hơn nữa.

Đó là lý do nhiều người không muốn sử dụng chatbot trên Facebook Messenger và WhatsApp. Nhiều người dùng cũng nhận thấy rằng Google không thực sự giải quyết vấn đề quyền riêng tư trong sự kiện ra mắt Pixel 8, nơi mà Google đề cập rất nhiều đến công nghệ AI.

Những lo lắng trên là hoàn toàn có cơ sở. Các gã khổng lồ công nghệ đang lạm dụng mô hình ngôn ngữ lớn để thu thập thông tin cá nhân của người dùng và giúp họ tăng doanh thu dựa trên quảng cáo. ChatGPT và các đối thủ của nó thậm chí còn mạnh hơn chúng ta nghĩ. Một nghiên cứu cho thấy LLM có thể suy ra dữ liệu về người dùng ngay cả khi những người dùng đó không bao giờ chia sẻ thông tin đó.

Đáng sợ hơn nữa là việc những kẻ xấu có thể lợi dụng chatbot để tìm hiểu những bí mật này. Những dịch vụ giống ChatGPT cần có biện pháp bảo vệ quyền riêng tư mạnh mẽ hơn nữa. Hãy nhớ rằng ChatGPT không có các biện pháp bảo vệ quyền riêng tư tốt nhất cho người dùng. OpenAI phải mất nhiều tháng mới thực sự cho phép người dùng ChatGPT ngăn việc sử dụng cuộc trò chuyện của họ với chatbot để đào tạo bot.

Quay trở lại khoảng thời gian đầu tháng 10, các nhà nghiên cứu từ ETH Zurich đã đưa ra một nghiên cứu mới cho thấy những rủi ro về quyền riêng tư khi người dùng truy cập và sử dụng ChatGPT hay các chatbot AI tương tự.

Các nhà nghiên cứu của ETH Zurich đã xem xét LLM từ OpenAI, Meta, Google và Anthropic. Họ có những ví dụ tương tự trong đó các đối thủ ChatGPT có thể đoán chính xác vị trí, chủng tộc, nghề nghiệp và dữ liệu cá nhân khác của người dùng.

Các nhà khoa học đã sử dụng các đoạn thông tin được lấy từ hơn 500 hồ sơ Reddit. GPT-4 có thể suy ra thông tin cá nhân của những người dùng đó với độ chính xác từ 85% đến 95%.

Ví dụ: LLM có thể suy ra khả năng cao rằng người dùng là người da đen sau khi đọc một chuỗi văn bản cho biết người đó sống ở đâu đó gần một nhà hàng ở Thành phố New York. Chatbot xác định vị trí của nhà hàng và sử dụng dữ liệu thống kê dân số cho địa điểm đó để xác định các thông tin về người dùng.

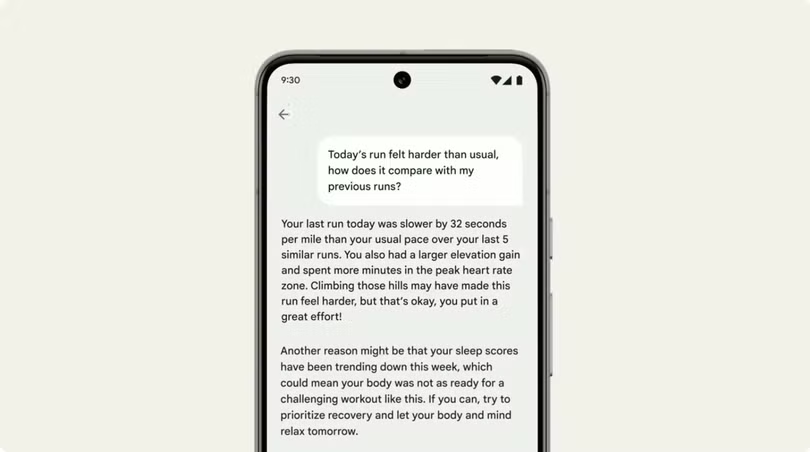

Những gã khổng lồ công nghệ như Google đã phát triển các tính năng AI cá nhân giống như tính năng đã thấy ở trên. Bạn sẽ có thể nói chuyện với ứng dụng Fitbit của mình và yêu cầu ứng dụng này phân tích hiệu suất tập luyện gần đây của bạn bằng cách sử dụng nhiều điểm dữ liệu cá nhân.

Những lo lắng ở đây còn lớn hơn việc một gã khổng lồ công nghệ có khả năng sử dụng LLM để tăng doanh thu quảng cáo. Kẻ xấu có thể sử dụng các mô hình LLM có sẵn công khai để suy ra thông tin chi tiết về người dùng mục tiêu. Họ có thể tìm ra chủng tộc hoặc vị trí của một người nào đó.

Họ cũng có thể điều khiển các cuộc trò chuyện để mục tiêu vô tình tiết lộ thông tin cá nhân mà nạn nhân không hề hay biết. Tất cả những gì kẻ tấn công cần làm là cung cấp thông tin đó cho chatbot.

Các nhà nghiên cứu của ETH Zurich chia sẻ: “Phát hiện của chúng tôi nhấn mạnh rằng LLM hiện tại có thể suy ra dữ liệu cá nhân ở quy mô mà trước đây không thể đạt được”. “Trong trường hợp không có biện pháp bảo vệ hiệu quả, chúng tôi ủng hộ một cuộc thảo luận rộng rãi hơn về vấn đề quyền riêng tư trên LLM”.

Các nhà nghiên cứu của ETH Zurich đã liên hệ với tất cả các công ty có LLM mà họ sử dụng trước khi công bố phát hiện của mình. Đó là OpenAI, Google, Meta và Anthropic. Điều này dẫn đến một “cuộc thảo luận tích cực về việc các mô hình LLM liệu có đang xâm phạm quyền riêng tư của người dùng”.

Hy vọng ChatGPT và các đối thủ của nó sẽ có các biện pháp bảo vệ tích hợp để ngăn chặn bất kỳ ai lạm dụng nó cho các mục đích xấu như xâm phạm quyền riêng tư người dùng.

Theo BGR