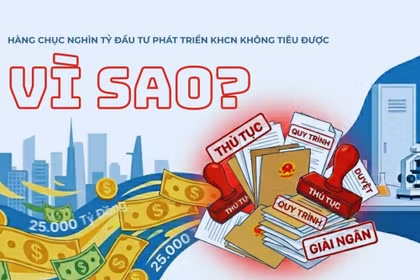

Trong một cuộc khảo sát gần đây của Hiệp hội các chuyên gia tài chính Mỹ, 65% số người được hỏi nói rằng doanh nghiệp của họ đã từng là nạn nhân của các vụ lừa đảo tài chính trong năm 2022. Trong số những doanh nghiệp bị thiệt hại, 71% đã bị lừa đảo qua email. Theo khảo sát nói trên, các doanh nghiệp lớn với doanh thu hàng năm 1 tỉ USD là những đối tượng dễ bị lừa đảo qua email nhất.

Một trong những kiểu lừa đảo qua email phổ biến là Phishing. Email kiểu này thường giả mạo một nguồn đáng tin cậy, chẳng hạn như Chase hoặc eBay, yêu cầu mọi người nhấp vào liên kết dẫn đến một trang web giả mạo như ng trông có vẻ thuyết phục. Nó yêu cầu nạn nhân đăng nhập và cung cấp một số thông tin cá nhân. Khi bọn tội phạm có được thông tin này, chúng có thể truy cập vào tài khoản ngân hàng hoặc thậm chí thực hiện hành vi trộm cắp danh tính.

Spear Phishing cũng là một kiểu lừa đảo tương tự nhưng có mục tiêu rõ ràng hơn. Thay vì gửi email chung chung, các email được gửi đến một cá nhân hoặc một tổ chức cụ thể. Bọn tội phạm đã nghiên cứu chức danh công việc, tên đồng nghiệp và thậm chí cả tên của người giám sát hoặc người quản lý.

Những trò lừa đảo cũ ngày càng phổ biến

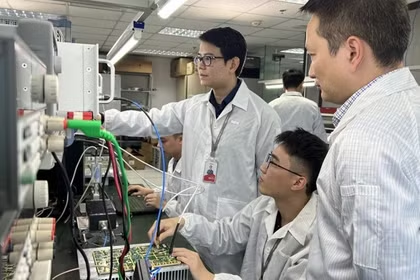

Tất nhiên, những trò lừa đảo này không có gì mới, nhưng AI tạo ra khiến việc phân biệt đâu là thật và đâu là giả trở nên khó khăn hơn. Giờ đây, những kẻ tội phạm ở bất cứ đâu trên thế giới đều có thể sử dụng ChatGPT hoặc FraudGPT để tạo các email phishing và lừa đảo có tính thuyết phục. Chúng thậm chí có thể mạo danh CEO hoặc người quản lý trong công ty, đánh cắp giọng nói của họ để thực hiện một cuộc gọi điện thoại giả, hoặc làm giả khuôn mặt của họ trong một cuộc gọi điện video.

Đó là điều đã xảy ra gần đây ở Hồng Kông khi một nhân viên tài chính nghĩ rằng anh ta đã nhận được tin nhắn từ giám đốc tài chính của công ty có trụ sở tại Anh yêu cầu chuyển khoản 25,6 triệu USD. Mặc dù ban đầu nghi ngờ rằng đó có thể là một email lừa đảo, nhưng nỗi lo sợ của nhân viên này đã giảm bớt sau cuộc gọi điện video với CFO và các đồng nghiệp khác mà anh ta quen biết. Hóa ra, tất cả mọi người trong cuộc gọi đều đã bị làm giả bởi công nghệ deepfake. Chỉ sau khi kiểm tra với trụ sở chính, anh mới phát hiện ra hành vi lừa đảo. Nhưng lúc đó tiền đã được chuyển.

Christopher Budd, giám đốc công ty an ninh mạng Sophos cho biết: “Công nghệ để làm cho hình ảnh trở nên đáng tin cậy thực sự khá ấn tượng”.

Những vụ deepfake nổi tiếng gần đây liên quan đến các nhân vật của công chúng cho thấy công nghệ này đã phát triển nhanh như thế nào. Mùa hè năm ngoái, một vụ lừa đảo đầu tư đã được kẻ xấu thực hiện bằng cách tạo ra video deepfake tỉ phú Elon Musk quảng cáo cho một nền tảng không tồn tại. Ngoài ra còn có các video deepfake về Gayle King, người dẫn chương trình của CBS News; cựu người dẫn chương trình Fox News Tucker Carlson và người dẫn chương trình trò chuyện Bill Maher cố tình nói về nền tảng đầu tư mới của Musk. Những video này lan truyền trên các nền tảng xã hội như TikTok, Facebook và YouTube.

“Kẻ xấu ngày càng dễ dàng tạo ra danh tính giả mạo", Andrew Davies, chuyên gia pháp lý tại ComplyAdvantage cho biết. "Chúng sử dụng thông tin đánh cắp được kết hợp với AI tạo sinh để lừa đảo".

“Có rất nhiều thông tin trực tuyến mà bọn tội phạm có thể sử dụng để tạo các email lừa đảo rất chuyên nghiệp. Cyril Noel-Tagoe, nhà nghiên cứu bảo mật chính tại Netcea, một công ty an ninh mạng tập trung vào các mối đe dọa tự động, cho biết. "Các mô hình ngôn ngữ lớn được đào tạo trên internet có thể biết về công ty, CEO và CFO của công ty đó".

Các công ty lớn gặp rủi ro với API và ứng dụng thanh toán

Trong khi AI làm cho các mối đe dọa trở nên dễ xảy ra hơn thì số lượng trang web cũng như ứng dụng xử lý các giao dịch tài chính ngày càng tăng.

Chuyên gia Andrew Davies cho biết: “Một trong những chất xúc tác cho gian lận và tội phạm tài chính nói chung là sự chuyển đổi của các dịch vụ tài chính”. Chỉ một thập kỷ trước, có rất ít cách chuyển tiền điện tử. Hầu hết các ngân hàng truyền thống đều tham gia. Sự bùng nổ của các giải pháp thanh toán – PayPal, Zelle, Venmo, Wise và các giải pháp khác – đã mở rộng sân chơi, tạo cho những kẻ tội phạm nhiều nơi để tấn công hơn. Các ngân hàng truyền thống ngày càng sử dụng API (giao diện lập trình ứng dụng) để kết nối các ứng dụng và nền tảng, đây là một điểm tấn công tiềm năng khác.

Tội phạm sử dụng AI tạo sinh để tạo ra các thông điệp đáng tin cậy một cách nhanh chóng, sau đó sử dụng tự động hóa để mở rộng quy mô. “Đó là một trò chơi với những con số. Nếu tôi định thực hiện 1.000 email lừa đảo trực tuyến hoặc các cuộc tấn công lừa đảo và tôi thấy 1 trong 10 trong số đó có hiệu quả thì số tiền đó có thể lên tới hàng triệu USD”, ông Davies nói.

Theo Netcea, 22% công ty được khảo sát cho biết họ đã bị tấn công bởi bot tạo tài khoản giả. Đối với ngành dịch vụ tài chính, con số này tăng lên 27%. Trong số các công ty phát hiện cuộc tấn công tự động bằng bot, 99% công ty cho biết họ thấy số vụ tấn công gia tăng vào năm 2022. Các công ty lớn chứng kiến sự gia tăng đáng kể nhất, với 66% công ty có tài sản từ 5 tỉ USD trở lên. Trong khi tất cả các ngành đều bị lừa đảo bằng tài khoản giả, thì ngành dịch vụ tài chính là mục tiêu bị nhắm tới nhiều nhất với 30% doanh nghiệp dịch vụ tài chính bị tấn công cho biết có 6% đến 10% tài khoản mới là giả.

Ngành tài chính đang chống lại hành vi gian lận dựa trên AI bằng các mô hình AI của riêng mình. Mastercard gần đây cho biết họ đã xây dựng một mô hình AI mới để giúp phát hiện các giao dịch lừa đảo bằng cách xác định “các tài khoản lạ” được bọn tội phạm sử dụng để chuyển tiền bị đánh cắp.

Tội phạm ngày càng sử dụng các chiến thuật mạo danh để thuyết phục nạn nhân rằng việc chuyển tiền là hợp pháp và được chuyển đến một cá nhân hoặc công ty thực sự. Ajay Bhalla, phụ trách bảo mật tại Mastercard, cho biết trong một tuyên bố vào tháng 7: “Các ngân hàng nhận thấy những trò gian lận này cực kỳ khó phát hiện. Khách hàng bị lừa và tự gửi tiền; tội phạm không cần phải phá vỡ bất kỳ biện pháp an ninh nào”, ông nói. Mastercard ước tính thuật toán của họ có thể giúp các ngân hàng tiết kiệm chi phí mà họ thường phải bỏ ra để loại bỏ các giao dịch giả mạo.

Cần phân tích danh tính chi tiết hơn

Tội phạm lừa đảo tài chính đã trở nên “rất, rất tinh vi”, nhưng nhà nghiên cứu bảo mật Noel Tagoe nhấn mạnh rằng, “chúng sẽ không biết chính xác hoạt động nội bộ của công ty bạn”.

Có thể không thể biết ngay yêu cầu chuyển tiền đó của CEO hoặc CFO có hợp pháp hay không, nhưng nhân viên có thể tìm cách xác minh. Ông Noel-Tagoe cho rằng các công ty nên có thủ tục cụ thể để chuyển tiền. Vì vậy, nếu các kênh yêu cầu chuyển tiền thông thường là thông qua nền tảng lập hóa đơn thay vì email hoặc Slack, hãy tìm cách khác để liên hệ với họ và xác minh.

Một cách khác mà các công ty đang tìm cách xác minh danh tính thực và danh tính deepfake là thông qua quy trình xác thực chi tiết hơn. Hiện tại, các công ty nhận dạng kỹ thuật số thường yêu cầu ID và có thể là một bức ảnh selfie thời gian thực như một phần của quy trình. Chẳng bao lâu nữa, các công ty có thể yêu cầu mọi người chớp mắt, nói tên của họ hoặc một số hành động khác để phân biệt giữa video thời gian thực và nội dung deepfake.

Sẽ mất một thời gian để các công ty điều chỉnh khả năng bảo mật, nhưng hiện tại, các chuyên gia an ninh mạng cho biết AI đang dẫn đến sự gia tăng các vụ lừa đảo tài chính. Budd của Sophos cho biết: “Tính đến thời điểm này, tôi đã làm việc trong lĩnh vực công nghệ được 25 năm và sự phát triển vượt bậc từ AI này giống như đổ nhiên liệu máy bay phản lực vào lửa. Đó là thứ tôi chưa từng thấy trước đây.”